Los alumnos de las asignaturas de Marco Ético y Legal del Grado de Ingeniería de Datos de la Universidad Politécnica de Madrid han comenzado a experimentar de forma práctica conceptos de Ciencia de Datos Ética en el curso 2025/26. Este año se han integrado en la asignatura dos casos prácticos sobre sesgo, equidad y explicabilidad:

- Studying Racial Bias in Predicting Risk of Recidivism in the US Criminal Justice System. En este caso, basado en la famosa y controvertida investigación de ProPública, los estudiantes han podido aplicar distintos tests de equidad a un conjunto de datos de entrada y la salida de un modelo de predicción de la probabilidad de reincidencia de reos de la justicia en Estados Unidos.

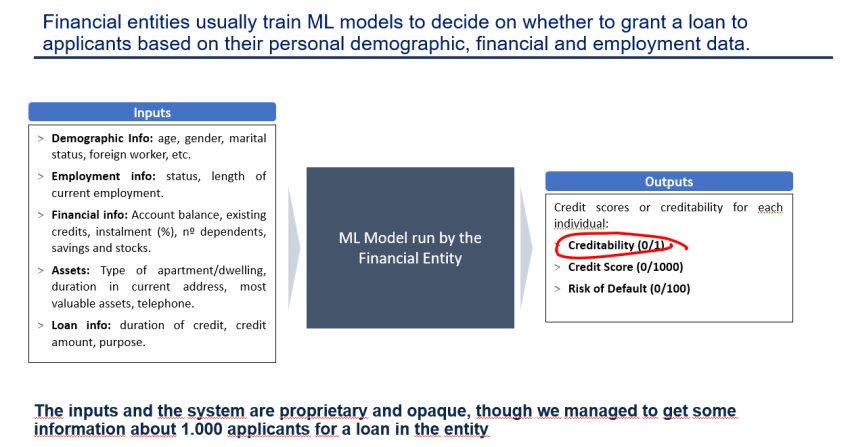

- Using Interpretable Machine Learning to Study Bias in Credit Scoring Algorithms. En este caso, basado en el dataset “german credit”, los alumnos han aplicado diversas técnicas de explicabilidad e interpretabilidad de modelos de aprendizaje automático para determinar si existe algún sesgo por razón de nacionalidad en la concesión de créditos por parte de una entidad bancaria.

Además de la invitación a la reflexión, los casos prácticos invitan a “aprender haciendo”, lo que esperamos refuerce la fijación de los conceptos y haga más divertida la asignatura. Adicionalmente, CAMELIA ha generado otros cuatro casos de estudio de aprendizaje de conceptos de IA ética, que a través de debates y discusión en clase permiten introducir dilemas éticos derivados de esta tecnologías en las clases.

Gracias especialmente a Diego Castro Freire por su ayuda en la puesta en marcha de estos casos prácticos, y a la Universidad Politécnica de Madrid por financiar la iniciativa a través del Proyecto de Innovación Corporativa CAMELIA (CAsos prácticos sobre el Marco Ético y Legal de la Inteligencia Artificial).

About Santiago Andrés Azcoitia

- Web |

- More Posts(9)

Muy interesante, gracias.